2023 年 5 月 3 日午後 5 時 44 分科学

物理学者数多くの作品と普及者としての才能が認められ、スティーブン・ホーキング博士~の危険性を長い間警告してきた人工知能人類の未来のために。しかし、正確にはなぜでしょうか?

人類の未来にとって危険なAI

スティーブン・ホーキング博士(1942–2018)はイギリスの物理学者、理論家、宇宙学者でした有名な。特にブラックホールに関する研究で知られ、彼は何よりも優れた大衆化者として有名でした。私たちは特にその本に対して彼に借りがある簡単な歴史』(1988年)は1000万部以上を売り上げた。したがって、彼のような科学者が人工知能のような広大かつ複雑なテーマについて発言するとき、彼の言葉には必然的に重みが生まれます。

したがって、私たちの多くが歓迎していることを懸念しています。AIの大規模な開発に対する彼の複数の警告。このテーマに関する彼の最も有名な介入の 1 つは 2014 年に遡ります。BBCとのインタビューで。それから彼はこう宣言した 「の開発人工知能完成すれば人類に死の鐘を鳴らすことができるだろう」。表現が何であるかを定義することはまだ残っています「完全な人工知能」手段。いずれにしても、彼は、AI が十分に強力であることを恐れていました。「再定義」それ自体を改善し、「常に速く」日の目を見ます。「生物進化の遅さによって限界を感じた人類は太刀打ちできず、取って代わられてしまうだろう。」

スティーヴン・ホーキング博士のニュアンスのあるコメント (つまり、彼自身について + 「大きな出来事」)

彼の衝撃的な宣言から数カ月後、スティーブン・ホーキング博士は、「殺人ロボット」に対する公開書簡に署名することで、AIに対する運動を続けました。人工知能に基づく軍拡競争を恐れる他の多くの研究者や科学者と並んで、「人間の介入なしに目標と戦う」。それにもかかわらず、彼は定期的に次のことを思い出させて自分の発言を限定しました。「AIは私たちの文明の歴史の中で最悪の出来事になる可能性があります」、 それはまた貴重な助けとなり、希望をもたらします。これは、2017 年に開催されたカンファレンス中に彼が特に思い出したことです。

効果的な AI の作成に成功することは、私たちの文明の歴史の中で最大の出来事になる可能性があります。あるいは最悪です。ただ私たちには分かりません。したがって、私たちは AI によって無限に助けられるのか、それとも AI に無視されて脇に追いやられるのか、あるいは AI によって破壊される可能性さえあるのかを知ることはできません。私たちが潜在的なリスクに備えて回避する方法を学ばなければ、AI は文明史上最悪の出来事になる可能性があります。 [...]

[でも]私は私は楽観主義者で、世界のために AI を活用できると信じています。彼らは私たちと調和して働くことができると信じています。 「私は楽観主義者で、世界のために AI を開発できると信じています。彼が私たちと調和して働くことができるように。私たちは危険性を認識しなければなりませんが、それらを特定し、可能な限りベストプラクティスと管理を使用し、事前にその結果に備えてください。

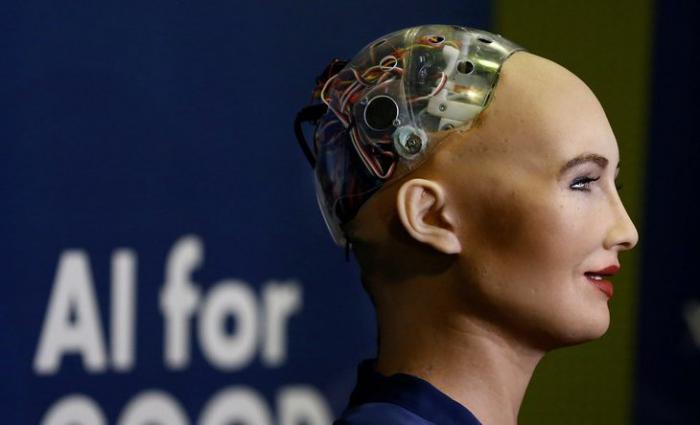

最後に、思い出してみましょうスティーブン・ホーキング博士自身も、シャルコー病にもかかわらず、主に人工知能のおかげでなんとか生き続け、コミュニケーションを続けることができました。まともに話すことができない彼は、「イコライザー」と呼ばれる合成音声生成技術を頼りに、自分の言葉を理解して講義することもできるようになりました。したがって、AI は確かに人間にとって有益であることが証明されます。